Les principes fondamentaux du pipeline ETL moderne pour l’analyse avancée

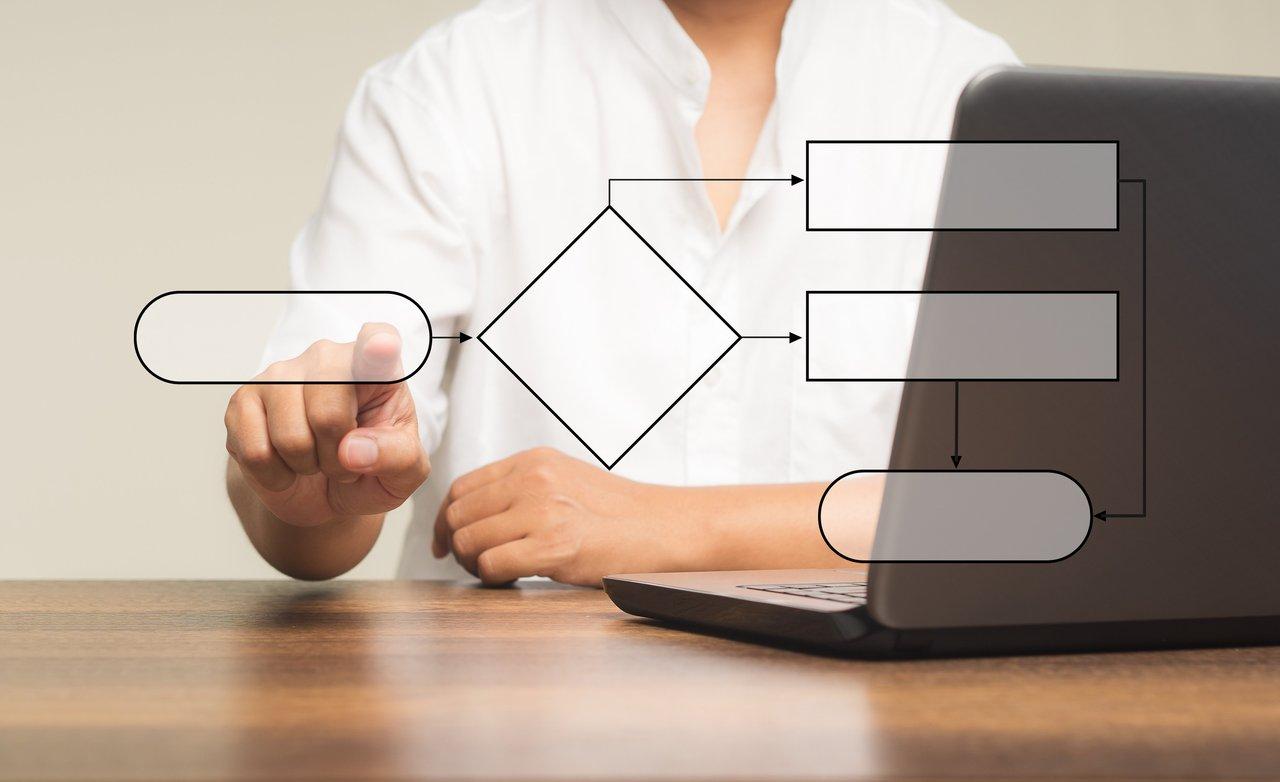

Un pipeline ETL (Extraction, Transformation, Chargement) est un enchaînement structuré de processus visant à extraire des données brutes issues de sources diverses, effectuer des transformations analytiques adaptées, puis charger les données dans des systèmes cibles (entrepôts ou lacs de données) pour une analyse fiable et approfondie.

L’ETL moderne se caractérise par l’intégration d’architectures cloud natives, d’une capacité à traiter les données en flux continu (streaming) et l’automatisation complète des workflows, pour répondre aux exigences de volumes croissants, de diversité des données et de rapidité dans la prise de décision.

L’approche ELT (extraire, charger, transformer) et les techniques de CDC (capture des données modifiées) complètent les pratiques classiques, facilitant une ingestion en temps réel et une transformation déportée dans les entrepôts, améliorant modularité et flexibilité du pipeline.

La construction efficace d’un pipeline ETL moderne débute par une planification stratégique incluant l’identification exhaustive des sources (bases relationnelles, SaaS, API, IoT), le choix des systèmes cibles (ex. Amazon Redshift, Snowflake) et l’approche méthodologique adaptée au contexte analytique envisagé.

Optimisation des performances par scalabilité, parallélisme et automatisation

La scalabilité dynamique, permise par des architectures auto-scalables en cloud sécurisé, ajuste en temps réel la puissance de calcul et la mémoire, gérant efficacement la montée en charge dans des environnements big data et garantissant une exploitation souveraine des ressources.

Parallélisme des tâches pour réduire les délais

Le parallélisme des tâches consiste à exécuter simultanément plusieurs sous-processus ETL, réduisant drastiquement les délais de traitement et assurant une plus grande réactivité indispensable à l’analyse avancée en temps quasi réel.

Automatisation matrixielle pour fiabiliser les pipelines

L’automatisation intervient à tous les niveaux : planification des jobs, validation continue des flux, gestion automatique des erreurs, relance conditionnelle des processus échoués et monitoring intégré, minimisant les interventions manuelles et augmentant la fiabilité des pipelines.

La mise en cache de résultats intermédiaires évite le recalcul redondant dans les traitements distribués, allégeant la charge CPU et mémoire tout en accélérant considérablement le cycle complet d’extraction et chargement.

Cartographie et profilage des flux ETL pour identifier les goulots d’étranglement

Une cartographie précise des flux consiste à recenser exhaustivement toutes les sources, quantifier les volumes journaliers, et détailler les étapes du pipeline consommant les plus fortes ressources (CPU, mémoire, E/S disque).

Le profilage des tâches au moyen d’outils avancés comme Apache Spark et son interface Spark UI expose les graphes orientés acycliques (DAG), identifie les partitions surchargées et révèle précisément où les goulets d’étranglement apparaissent dans le pipeline.

La détection fine inclut l’analyse des temps d’exécution, l’utilisation des ressources, les latences réseaux et les erreurs fréquentes, ouvrant la voie à des optimisations ciblées et à une meilleure allocation des ressources.

Une cartographie régulière et mise à jour permet une supervision proactive, anticipant les points de congestion, particulièrement critique dans des contextes de volumes et complexité croissants, et favorise la résilience globale.

Ingénierie des fonctionnalités comme levier d’amélioration des analyses avancées

L’ingénierie des fonctionnalités transforme les données brutes en variables pertinentes et optimisées pour les modèles d’apprentissage automatique, augmentant la précision des prédictions tout en maîtrisant les coûts de calcul.

Elle repose sur des combinaisons d’analyses statistiques rigoureuses et d’expertises métier, créant de nouvelles variables issues de transformations temporelles, interactions complexes ou réductions dimensionnelles (par exemple PCA).

Cette étape nécessite un équilibre entre complexité et performance, privilégiant des représentations compactes mais informatives pour éviter le sur-ajustement et faciliter l’interprétabilité des modèles, facteur clé des déploiements en production.

L’ingénierie des fonctionnalités intègre également le traitement des données hétérogènes, issues d’API, IoT ou contenus non structurés, tirant profit du pipeline ETL moderne pour automatiser ces transformations et garantir la fraîcheur des variables.

Surveillance en temps réel et gouvernance pour garantir fluidité et fiabilité du pipeline

La surveillance en temps réel des pipelines utilise des systèmes de monitoring et des logs pour détecter rapidement anomalies, pics de charge, latences ou défaillances, permettant des actions correctives automatisées immédiates et une optimisation continue des ressources.

L’automatisation des mécanismes d’erreur et de reprise assure une résilience élevée, avec des validations de qualité en continu, des redémarrages conditionnels et un suivi des métriques clés garantissant la cohérence et l’intégrité des données.

La gouvernance des données encadre les processus ETL par des contrôles d’accès robustes, la traçabilité complète des transformations, et le respect des normes réglementaires, fortifiant la confiance dans les résultats analytiques.

Les architectures cloud natives intègrent ces fonctions de surveillance et gouvernance dans des plateformes modulaires (ex. AWS Glue, Snowflake, IBM DataStage), conciliant performances, conformité et adaptabilité pour des pipelines ETL modernes et agile.

| Aspect | Description | Exemple de solution cloud native |

|---|---|---|

| Monitoring en temps réel | Détection rapide des anomalies et déclenchement d’actions correctives | AWS CloudWatch, Prometheus |

| Automatisation des erreurs | Relances conditionnelles et validations de qualité continues | IBM DataStage, Fivetran |

| Gouvernance des données | Contrôles d’accès, traçabilité et conformité réglementaire | Snowflake, Informatica |

| Architecture auto-scalable | Adaptation dynamique des ressources selon la charge | Google BigQuery, Azure Synapse |

Pour approfondir les dimensions d’architecture et d’optimisation dans l’analyse big data, vous pouvez consulter des ressources spécialisées sur le choix de l’architecture de stockage distribuée ainsi que sur les outils de data visualisation pour interpréter les données qui complètent efficacement la compréhension opérationnelle des flux ETL.

Sources

- groupe-cyllene.com - Comment optimiser une data pipeline ETL pour des performances maximales - https://www.groupe-cyllene.com/comment-optimiser-une-data-pipeline-etl-pour-des-performances-maximales

- ibm.com - Modern ETL: Think Insights - https://www.ibm.com/fr-fr/think/insights/modern-etl

- astera.com - ETL Pipeline: Principes et fonctionnement - https://www.astera.com/fr/type/blog/etl-pipeline